Documentation Index

Fetch the complete documentation index at: https://docs.comfy.org/llms.txt

Use this file to discover all available pages before exploring further.

简单理解「模型」

在 ComfyUI 里,模型一般指真正参与运算的权重文件,例如 checkpoint、VAE、LoRA、ControlNet、放大模型等。安装包本身体积不大,这些文件默认不会随安装附带。常见做法是从网上下载后放进ComfyUI/models/ 对应子文件夹,或按工作流/模板提示补全;然后在画布上的加载器节点里选中该文件(界面里这类节点名称里通常带有 Load 字样)。

ComfyUI 支持的模型

- 官方直接覆盖的模型数量有限,但随着 ComfyUI 与开源社区的发展,支持面会持续扩展。一旦某模型纳入支持,通常会在 工作流模板 中增加对应模板,便于一键对照使用。

- 并非所有模型都能开箱即用。 若你使用的是 ComfyUI 原生支持的模型及其常见衍生/配套权重,请先 将 ComfyUI 更新到较新版本,并在 模板库 中确认是否已有匹配的模板与模型提示。

- 另一部分模型依赖社区提供的自定义节点 才能使用;不同作者的 模型路径、节点用法可能不一致。请务必阅读各项目自带的 README 或文档 并按说明操作。ComfyUI 本身扩展方式较自由,因此实现细节会因作者而异;需要安装或排查自定义节点时,可参考 如何安装自定义节点。

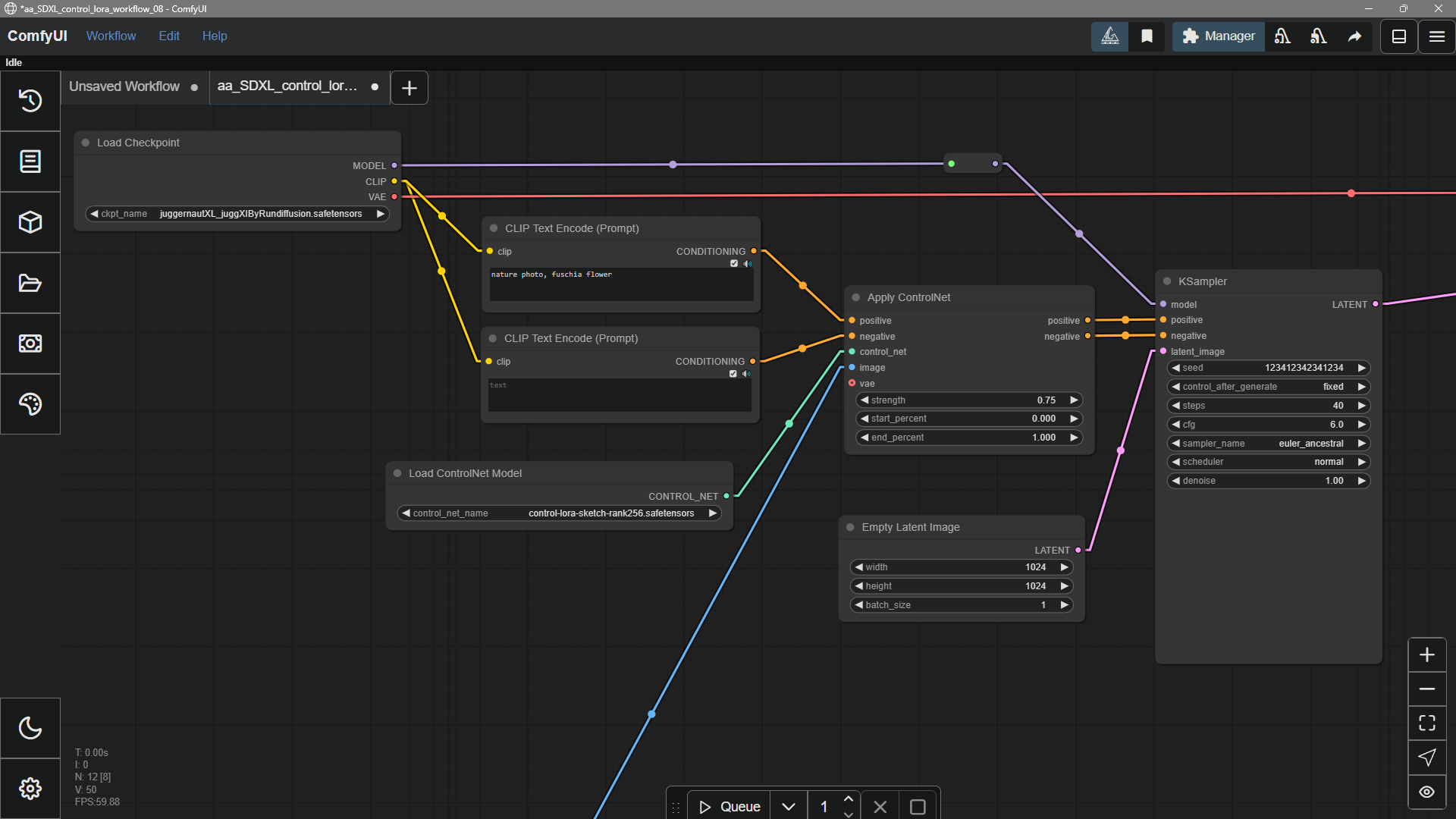

在 ComfyUI 里使用模型

- 放到正确目录 — 从 Hugging Face、Civitai 或 GitHub 等项目页下载后,放入

ComfyUI/models/下与类型对应的子文件夹(例如checkpoints、loras、vae)。 - 添加对应的加载器节点 — 按模型类型选择加载器(checkpoint、LoRA、VAE 等);在节点列表中,这类节点名称里通常带有 Load。

- 在加载器节点中选择 要用的模型文件。

- 把加载器节点连进工作流。若是手动拷贝文件且 ComfyUI 一直在运行,重启应用(或按界面提示刷新),以便列表更新。

预留磁盘与下载时间

单个生成模型经常是数 GB 级别。下载或同步前请预留足够磁盘空间和网络时间。主 checkpoint 之外的常用模型

主扩散 checkpoint 能完成很多任务,但常见工作流还会叠加体积更小的辅助模型,例如:- LoRA — 针对某种风格、角色或概念训练的轻量附加权重

- ControlNet — 用线稿、深度、姿态等引导构图

- Inpainting — 在已有图像的局部区域生成或替换内容

卸载模型

目前界面里没有统一的「卸载」入口。若要移除某个模型,请在ComfyUI/models/ 下找到当初放置的对应文件并手动删除。

添加外部模型路径

如果你想要在ComfyUI/models 之外管理你的模型文件,可能出于以下原因:

- 你有多个 ComfyUI 实例,你想要让这些实例共享模型文件,从而减少磁盘占用

- 你有多个不同的类型的 GUI 程序,如:WebUI, 你想要他们共用模型文件

- 模型文件无法被识别或读取到

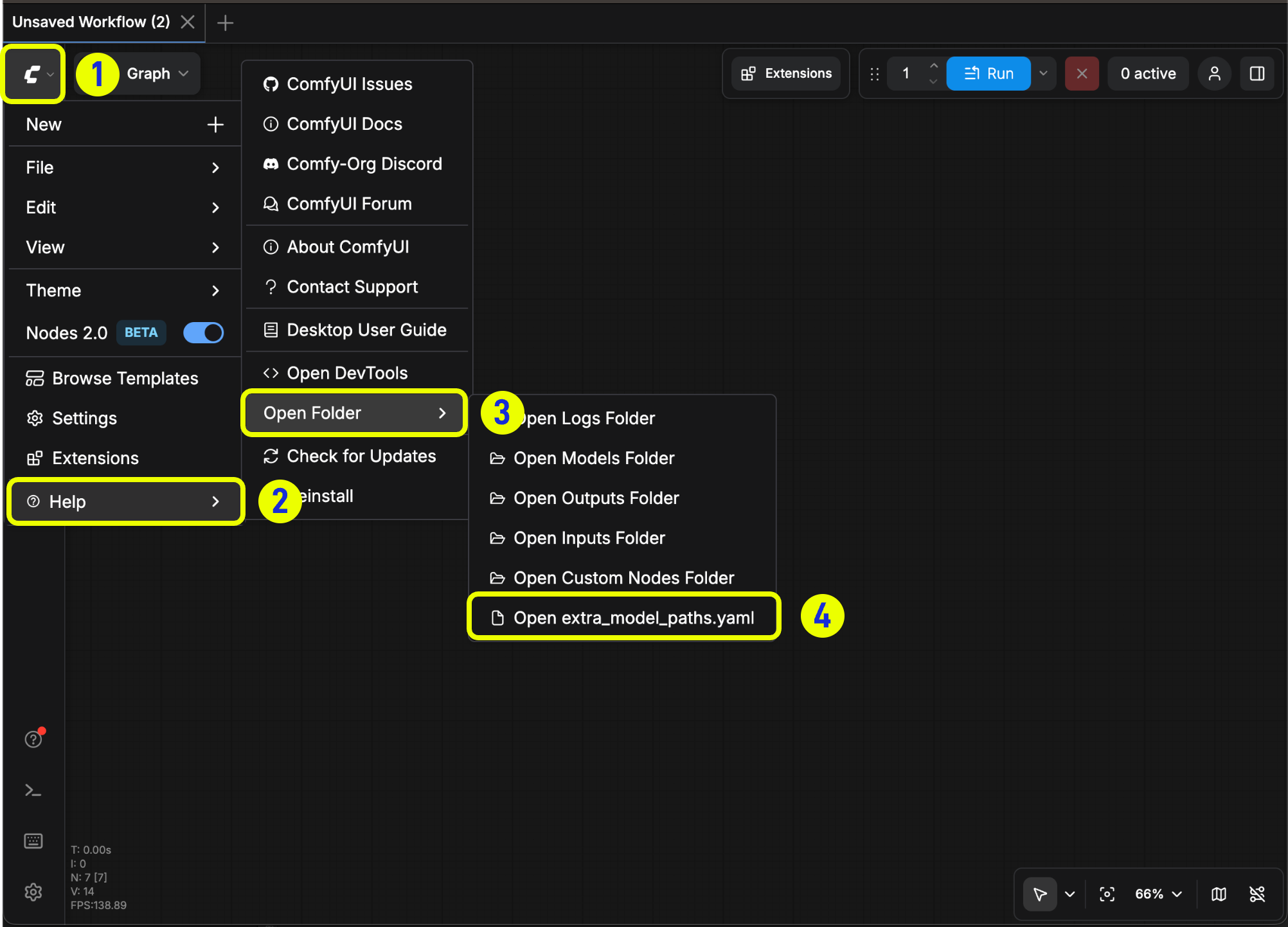

extra_model_paths.yaml 配置文件来添加额外模型搜索路径的方法。

不同 ComfyUI 版本配置文件位置

- Portable 及自部署

- ComfyUI Desktop

配置示例

比如,你需要额外让 ComfyUI 识别的模型文件位于下面的文件夹:添加额外自定义节点路径

除了添加外部模型之外,你同样可以添加不在 ComfyUI 默认路径下的自定义节点路径 下面是一个简单的配置示例(Mac 系统),请根据你的实际情况进行修改,并新增到对应的配置文件中,保存后需要 重启 ComfyUI 才能生效:常见问题

ComfyUI 支持 GGUF 格式的模型吗?

ComfyUI 支持 GGUF 格式的模型吗?

ComfyUI 原生不支持 GGUF 格式。需要使用社区自定义节点(例如 ComfyUI-GGUF)才能获得支持。

为什么找不到我的模型?

为什么找不到我的模型?

若已放入模型但在 ComfyUI 里看不到,可依次尝试:

- 确认路径与文件夹是否正确:

- ComfyUI Desktop:帮助 → 打开文件夹 → 打开模型文件夹,核对实际路径

- 文件是否放在对应子目录中(如

checkpoints、loras、vae)

- 按快捷键

r刷新节点定义,让 ComfyUI 重新扫描 - 重启 ComfyUI

- 在对应的加载器节点中确认已选中正确的模型

想多了解一点原理?

这里的「模型」到底指什么?

这里的「模型」到底指什么?

这里的 模型指保存了网络所学参数的数据文件,足以把输入(如文本与噪声)变成输出(如图像)。图像工作流里常见的是 扩散 checkpoint、CLIP 这类文本/图像编码器,以及 RealESRGAN 等放大模型。

基础模型与社区改版

基础模型与社区改版

实验室或开源项目发布的大型 基础模型偏通用。社区常在其基础上 微调、合并,得到新的 checkpoint 或 LoRA:画面更符合某种风格、在同等硬件上更省资源,或带来新能力——与在 Civitai、Hugging Face 上挑选模型是同一回事。