Documentation Index

Fetch the complete documentation index at: https://docs.comfy.org/llms.txt

Use this file to discover all available pages before exploring further.

動画ガイド

本人確認フローと、Seedance 2.0 実在人物向け2つのワークフローをComfyUIで最初から最後まで実行する手順を動画で確認できます。何が違うのか

- 実在人物 + 映画的コントロール — 人物の自然さを保ちながら、カメラ移動、ライティング、シーン変化を演出

- アイデンティティ一貫性 — 顔の特徴や全体の外観がモーションやカメラワーク、トランジションでも安定

- ネイティブ音声同期 — 映像と音声(セリフ、環境音、音楽)を同時生成し、口元や表情の同期がより安定

- マルチリファレンス指示 — テキストに加え、最大 9枚の画像、3本の動画、3本の音声 を組み合わせて見た目・動き・リズムを固定

ComfyUIでの本人確認(ライブネス)フロー

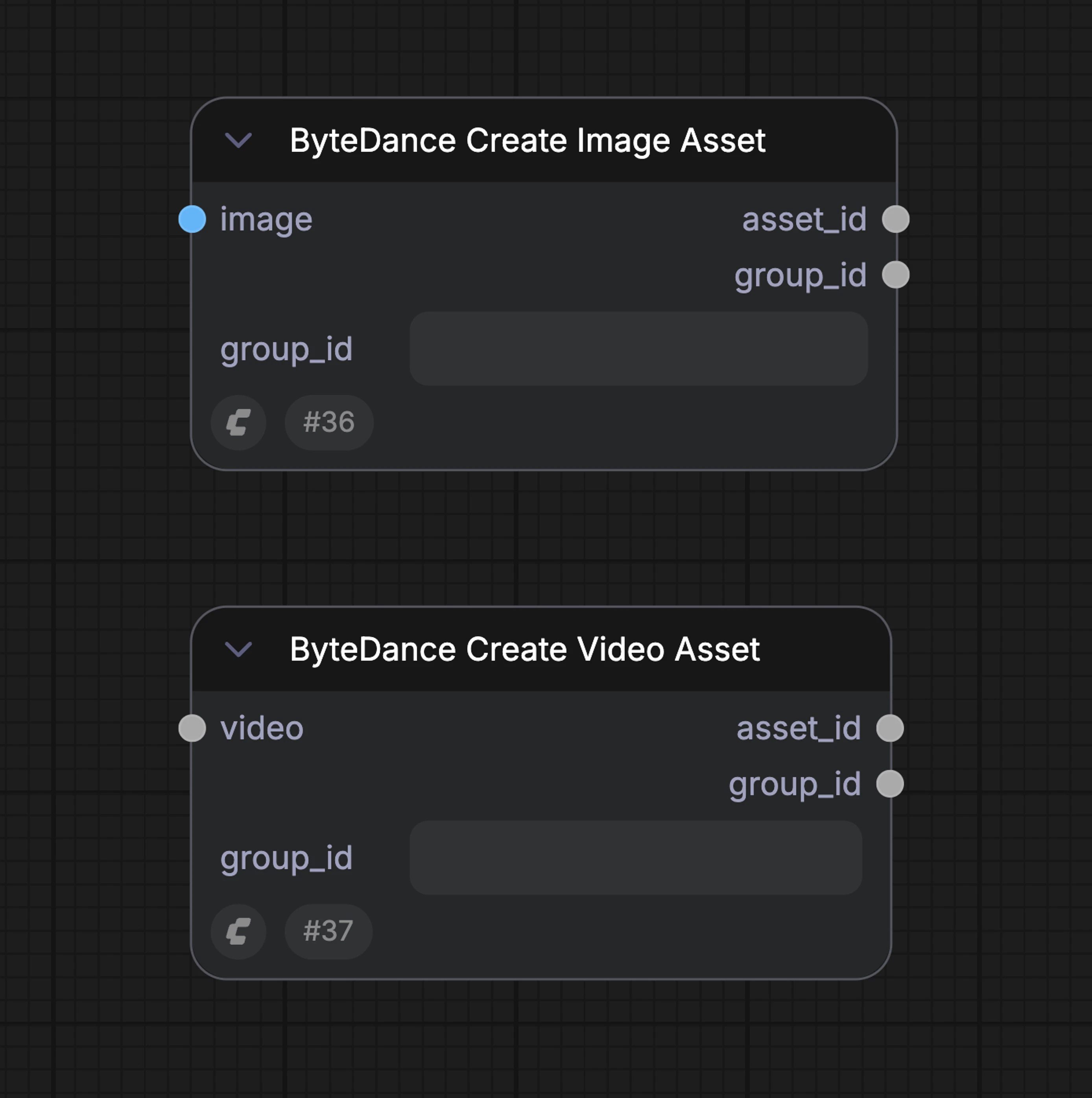

Seedance 2.0で実在人物を生成するには、事前に本人確認(ライブネス)が必要です。なりすましや無断での肖像利用を防ぐための仕組みで、ByteDance側で処理され、形成されつつあるAI透明性規制にも準拠しています。フロー全体はComfyUIの ByteDance Create Image/Video Asset ノードから開始でき、本人確認はスマホまたはブラウザで短時間だけ行います。

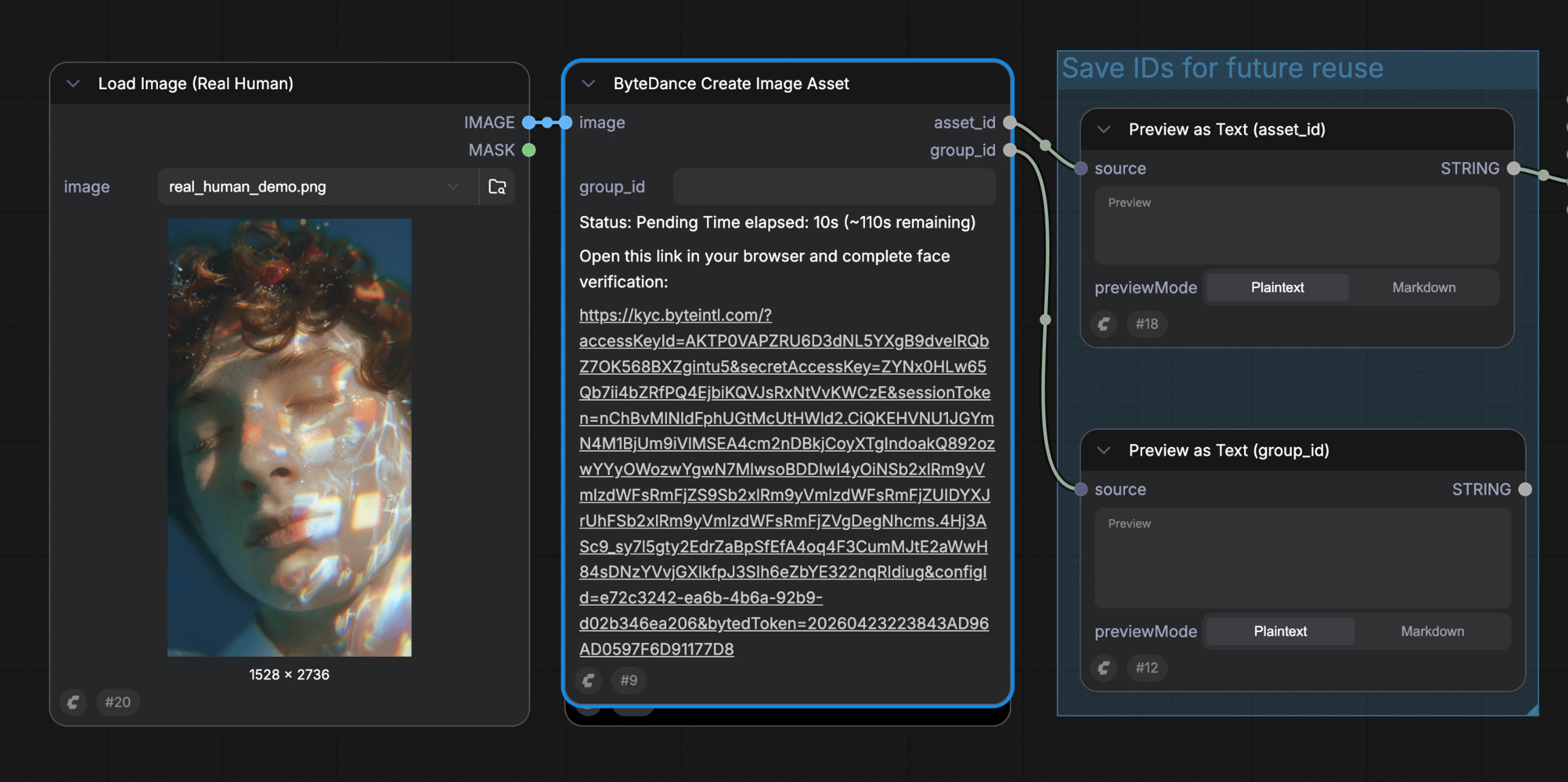

初回実行(本人確認が必要)

- ComfyUIで ByteDance Create Image/Video Asset ノードをワークフローに追加し、人物ポートレートをアップロード

- ワークフローを実行 — ByteDanceからの本人確認リンクがComfyUIに返ります

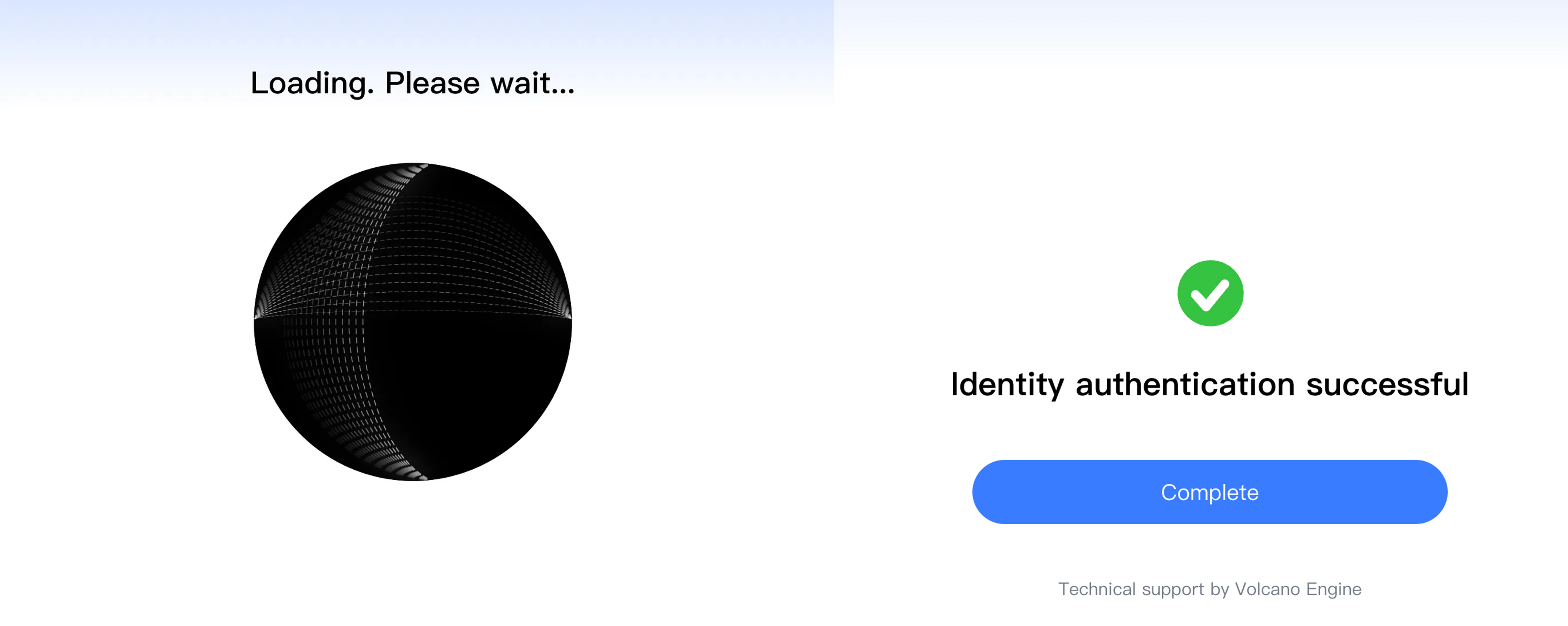

- リンクをスマホまたはブラウザで開き、本人確認(通常1分以内)を完了

- 確認完了後にComfyUIへ戻ると、ノード出力に検証済みアセットが含まれます

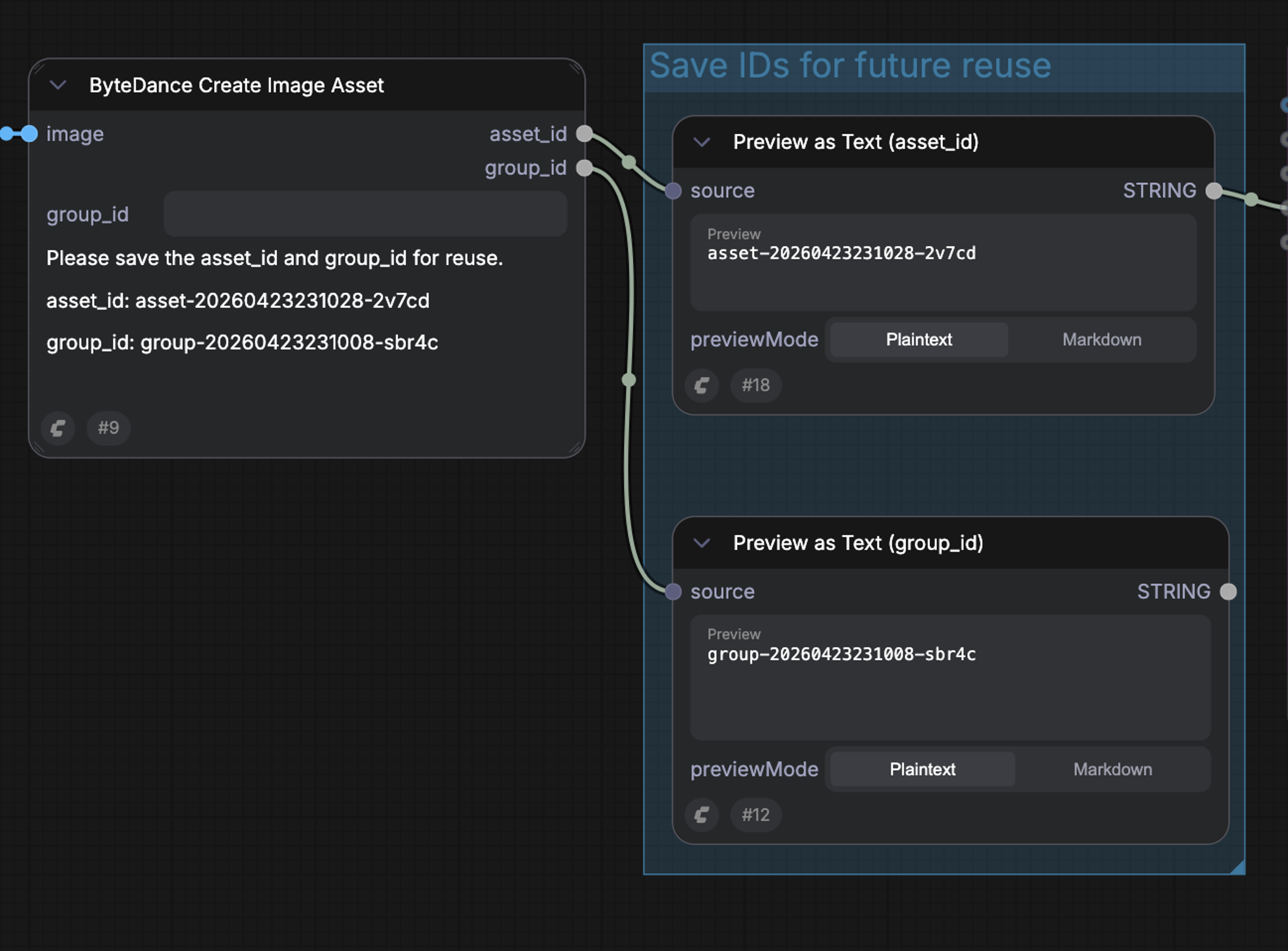

本人確認フローのスクリーンショット

Step 1 — アップロードして実行し、本人確認を開始

- Group ID — 検証済み人物を表します。後で再本人確認せずに同一人物を使うため、保存しておいてください

- Asset ID — この画像(または動画)アセット自体を表します。Seedance 2.0動画生成ノードへ接続して、検証済み人物の動画を生成できます。複数ワークフローで再利用可能です

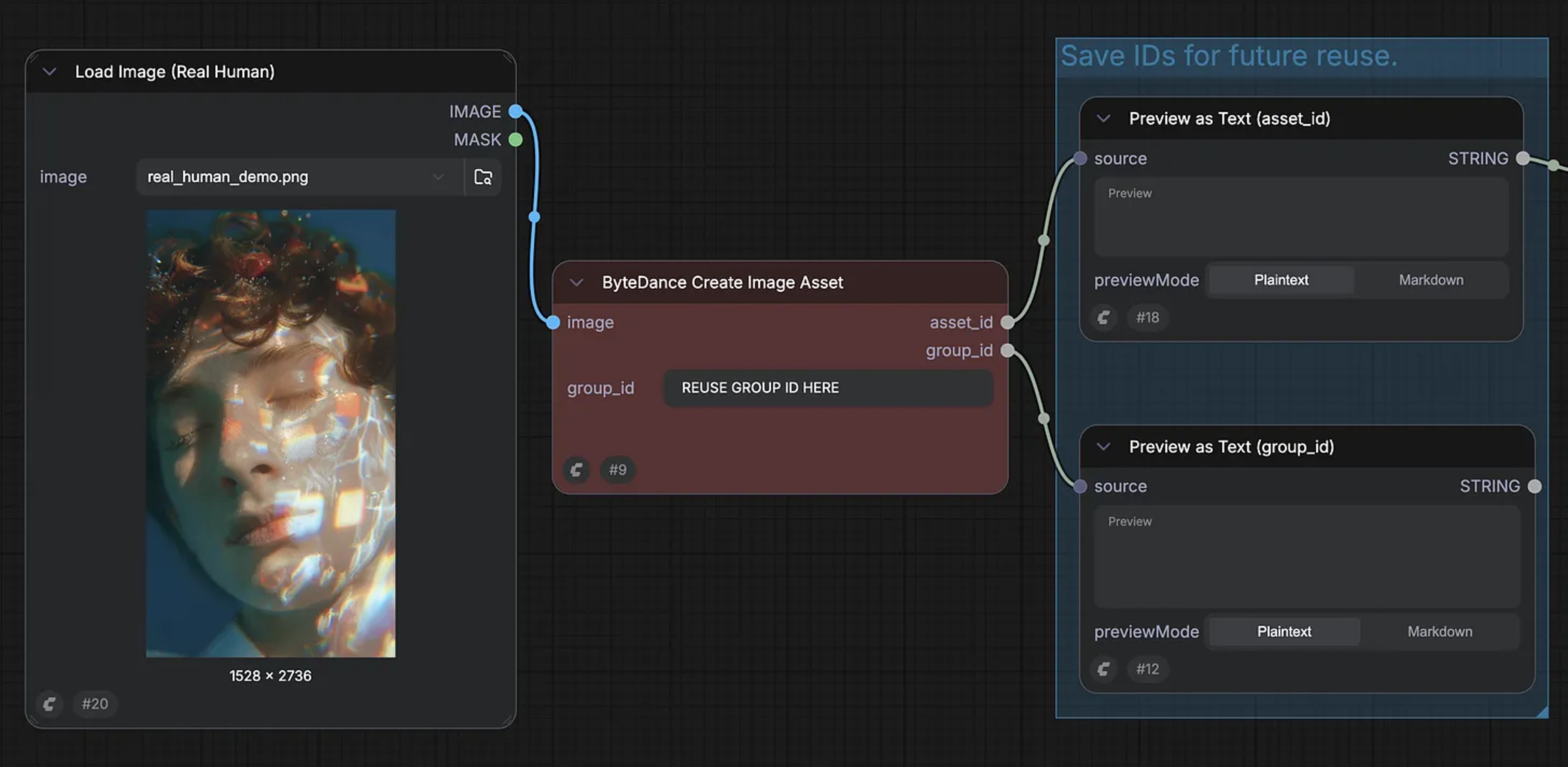

次回以降のアップロード(本人確認なし)

- ComfyUIで ByteDance Create Image/Video Asset ノードに、同じ人物の新しい画像または動画をアップロード

- 保存済みの Group ID をノードに入力

- 実行時にByteDanceが顔特徴を初回検証と照合

- 一致すれば、新アセットは自動的に有効化されComfyUIに返り、Seedance 2.0動画生成にそのまま利用できます

既存のGroup IDで本人確認をスキップ

初回は本人確認が必要ですが、同一人物の素材を追加する際に Group ID を入力し、同一人物として認識されればライブネス確認をスキップできます。

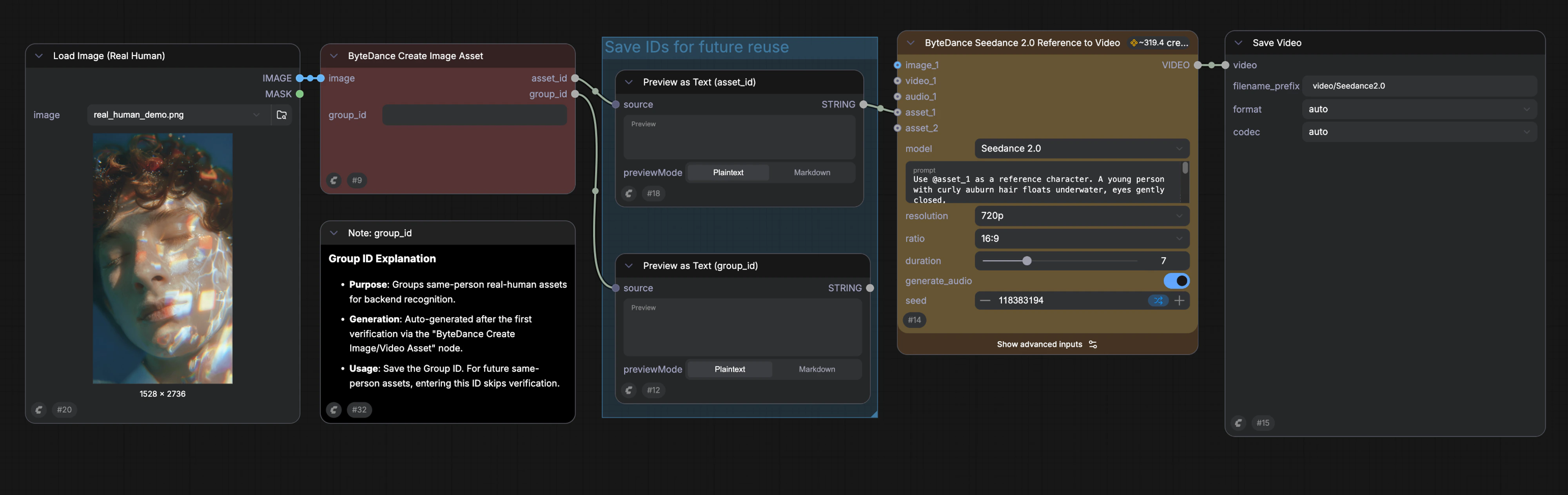

利用可能なワークフロー

ComfyUIにはSeedance 2.0 実在人物向けのテンプレートが2つ用意されています。どちらも ByteDance Create Image/Video Asset ノードをSeedance 2.0動画生成ノードへ接続し、1回の実行で「検証 + 生成」を完結できます。Seedance 2.0 実在人物 Reference-to-Video(R2V)

検証済みのポートレート(オプションで追加の参照画像/動画/音声)を用いて、実在人物のアイデンティティ一貫性を保ったSeedance 2.0動画を生成します。Seedance 2.0 実在人物 R2V ワークフロー

Reference-to-Videoワークフローファイルを取得します。

Seedance 2.0 実在人物 First-Last-Frame-to-Video(FLF2V)

検証済みの開始フレームと終了フレームを指定し、実在人物のアイデンティティを保ちながら間の動画を生成します。Seedance 2.0 実在人物 FLF2V ワークフロー

First-Last-Frame-to-Videoワークフローファイルを取得します。