Stability AI Stable Diffusion 3.5 Image ノードを使用すると、Stability AI の Stable Diffusion 3.5 モデルを活用し、テキストプロンプトまたは参照画像をもとに高品質でディテール豊かな画像コンテンツを作成できます。 本ガイドでは、このノードを用いたテキストから画像へおよび画像から画像へのワークフロー構築方法を紹介します。Documentation Index

Fetch the complete documentation index at: https://docs.comfy.org/llms.txt

Use this file to discover all available pages before exploring further.

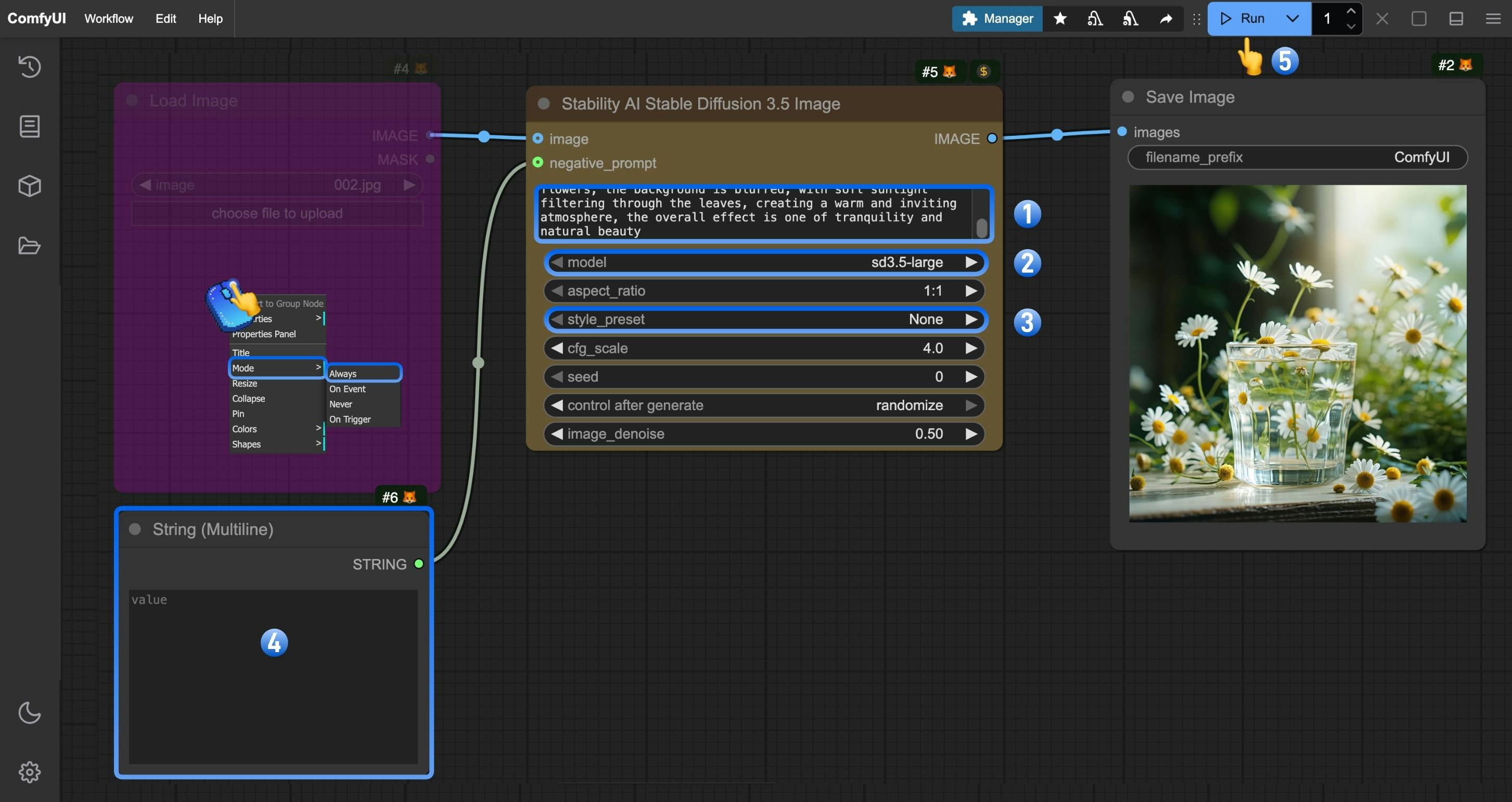

Stability AI Stable Diffusion 3.5 テキストから画像へ(文生図)ワークフロー

1. ワークフローファイルのダウンロード

以下の画像にはmetadata にワークフロー情報が含まれています。ダウンロードして ComfyUI にドラッグ&ドロップすることで、対応するワークフローを読み込むことができます。

2. ステップごとにワークフローを完了させる

- (任意)

Stability AI Stable Diffusion 3.5 Imageノード内のpromptパラメータを編集し、生成したい画像の説明文を入力します。より詳細なプロンプトを指定すると、通常はより高品質な画像が得られます。 - (任意)

modelパラメータから使用する SD 3.5 モデルのバージョンを選択します。 - (任意)

style_presetパラメータから画像のビジュアルスタイルを制御します。異なるプリセットは「cinematic(映画的)」や「anime(アニメ風)」など、それぞれ異なるスタイル特性を持つ画像を生成します。「None」を選択すると、特定のスタイルは適用されません。 - (任意)

String(Multiline)を編集してネガティブプロンプトを変更し、生成画像に含めたくない要素を指定します。 Runボタンをクリックするか、ショートカットキーCtrl(Windows)/Cmd(Mac) + Enterを使用して画像生成を実行します。- API からの結果が返された後、

Save Imageノードで生成された画像を確認できます。また、画像はComfyUI/output/ディレクトリにも保存されます。

3. 補足情報

- プロンプト(Prompt): プロンプトは生成プロセスにおいて最も重要なパラメータの一つです。詳細かつ明確な記述ほど、より良い結果が得られます。シーン、被写体、色調、ライティング、スタイルなどの要素を含めることができます。

- CFG Scale: プロンプトへの従い具合を制御します。値が大きいほど生成画像はプロンプトの記述に忠実になりますが、高すぎると過飽和や不自然な結果になる可能性があります。

- スタイルプリセット(Style Preset): 画像の全体的なスタイルを素早く定義できる複数のプリセットスタイルを提供します。

- ネガティブプロンプト(Negative Prompt): 生成画像に含めたくない要素を指定するために使用します。

- Seed パラメータ: 生成結果の再現や微調整に利用でき、創作時の反復作業に役立ちます。

- 現在、

Load Imageノードは「Bypass(バイパス)」モードになっています。有効化するには、ステップガイドを参照し、該当ノードを右クリックして「Mode(モード)」を「Always(常に)」に設定してください。これにより入力が有効になり、画像から画像へ(図生図)モードに切り替わります。 - 入力画像がない場合、

image_denoiseパラメータは効果を発揮しません。

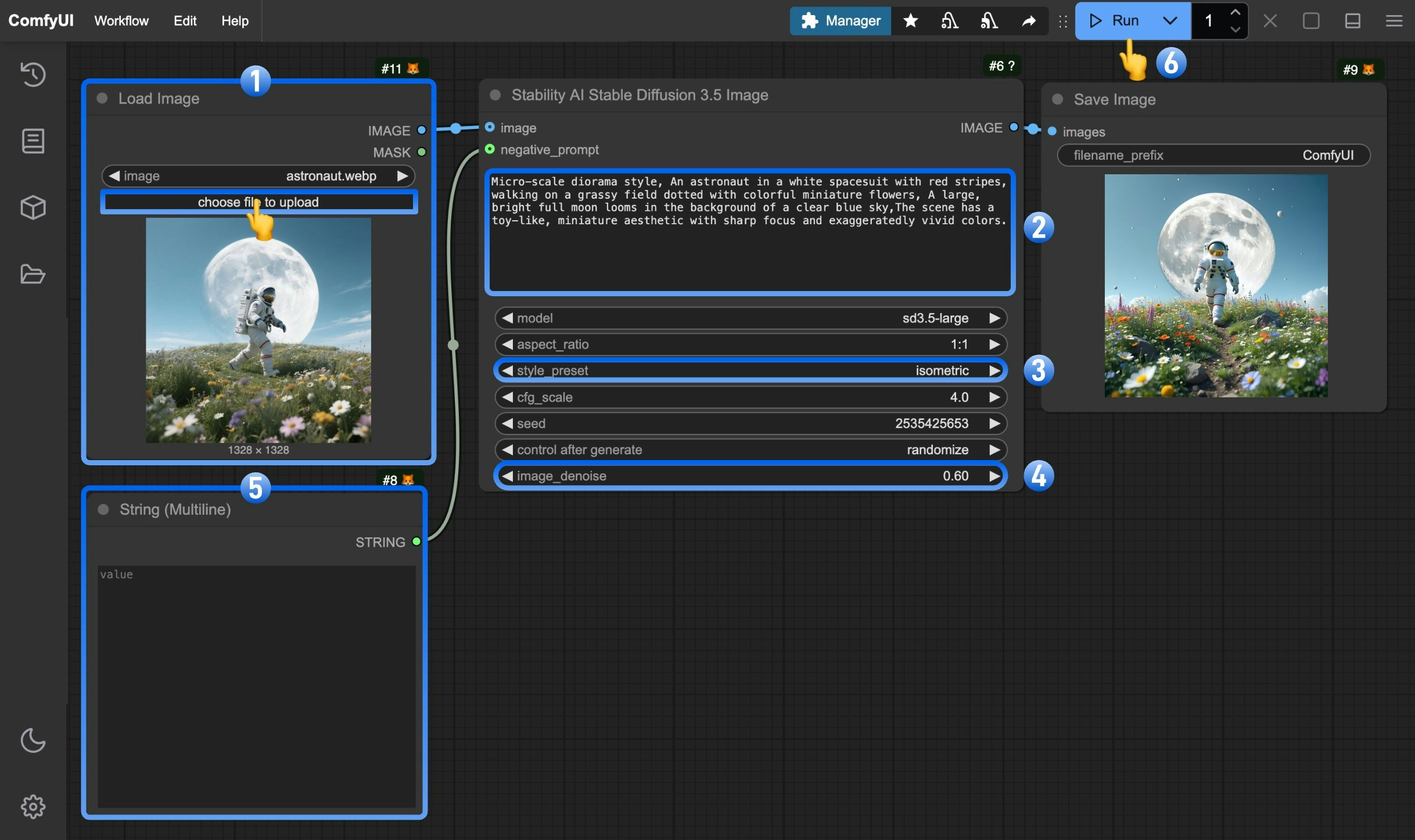

Stability AI Stable Diffusion 3.5 画像から画像へ(図生図)ワークフロー

1. ワークフローファイルのダウンロード

以下の画像にはmetadata にワークフロー情報が含まれています。ダウンロードして ComfyUI にドラッグ&ドロップすることで、対応するワークフローを読み込むことができます。

以下の画像を入力として使用するため、ダウンロードしてください

以下の画像を入力として使用するため、ダウンロードしてください

2. ステップごとにワークフローを完了させる

Load Imageノードを通じて参照画像を読み込み、これを生成の基盤とします。- (任意)

Stability AI Stable Diffusion 3.5 Imageノード内のpromptパラメータを編集し、参照画像に対して変更または強化したい要素を記述します。 - (任意)

style_presetパラメータから画像のビジュアルスタイルを制御します。異なるプリセットはそれぞれ異なるスタイル特性を持つ画像を生成します。 - (任意|重要)

image_denoiseパラメータ(範囲:0.0–1.0)を調整して、元の画像をどの程度変更するかを制御します:- 0.0 に近い値ほど、生成画像は入力参照画像に近くなります(0.0 の場合はほぼ元画像と同一になります)。

- 1.0 に近い値ほど、生成画像は純粋なテキストから画像へ(文生図)の結果に近くなります(1.0 の場合は、参照画像が提供されていないのと同じ状態になります)。

- (任意)

String(Multiline)を編集してネガティブプロンプトを変更し、生成画像に含めたくない要素を指定します。 Runボタンをクリックするか、ショートカットキーCtrl(Windows)/Cmd(Mac) + Enterを使用して画像生成を実行します。- API からの結果が返された後、

Save Imageノードで生成された画像を確認できます。また、画像はComfyUI/output/ディレクトリにも保存されます。

3. 補足情報

以下の画像は、同一のパラメータ設定で、入力画像あり/なしの場合の結果比較を示しています:

- 参照画像の選択: 明確な被写体と良好な構図を持つ画像を選ぶと、通常はより良い結果が得られます。

- プロンプトのコツ: 画像から画像へ(図生図)モードでは、プロンプトは既に画像内に存在するすべての要素を記述するのではなく、変更または強化したい要素に焦点を当てることが推奨されます。

- モードの切り替え: 入力画像が提供されると、ノードは自動的にテキストから画像へ(文生図)モードから画像から画像へ(図生図)モードに切り替わり、アスペクト比のパラメータは無視されます。

関連ノードの詳細

対応するノードの詳細なパラメータ設定については、以下のドキュメントをご参照ください。Stability Stable Diffusion 3.5 Image ノードドキュメンテーション

Stability Stable Diffusion 3.5 Image API ノードドキュメンテーション