Documentation Index

Fetch the complete documentation index at: https://docs.comfy.org/llms.txt

Use this file to discover all available pages before exploring further.

多くのフィードバックを受けており、提出される問題のほとんどがカスタムノードに関連していることがわかります。そのため、エラーレポートを提出する前に、問題が ComfyUI コアの問題によって引き起こされていないことを確認するために、カスタムノードのトラブルシューティングガイド を必ずお読みください。 カスタムノードトラブルシューティングガイド

カスタムノードが原因で発生する問題のトラブルシューティング方法を確認してください。

一般的な問題とクイックフィックス

詳細なトラブルシューティングに取り組む前に、これらの一般的な解決策を試してみてください:

ComfyUI が起動しない

症状: アプリケーションが起動時にクラッシュする、黒い画面が表示される、または読み込みに失敗する

クイックフィックス:

- システム要件を確認する - システムが最小要件 を満たしていることを確認してください

- GPU ドライバーを更新する - NVIDIA/AMD/Intel から最新のドライバーをダウンロードしてください

生成が失敗するかエラーが発生する

症状: 「Show report」ボタン付きの「Prompt execution failed」ダイアログが表示され、ワークフローの実行が停止する

クイックフィックス:

- 「Show report」をクリック - 詳細なエラーメッセージを読んで特定の問題を特定してください

- カスタムノードの問題かどうかを確認 - カスタムノードトラブルシューティングガイドに従ってください

- モデルファイルを検証 - モデル設定についてはモデルドキュメント を参照してください

- VRAM 使用量を確認 - GPU メモリを使用している他のアプリケーションを閉じてください

パフォーマンスが遅い

症状: 生成時間が非常に遅い、システムがフリーズする、メモリ不足エラーが発生する

クイックフィックス:

- 解像度/バッチサイズを下げる - 画像サイズまたは画像数を減らしてください

- メモリ最適化フラグを使用 - 以下のパフォーマンス最適化セクションを参照してください

- 不要なアプリケーションを閉じる - RAM と VRAM を解放してください

- CPU/GPU 使用量を確認 - タスクマネージャーを使用してボトルネックを特定してください

パフォーマンス最適化コマンド:

低 VRAM システム用:

# 低 VRAM モード(テキストエンコーダーに CPU を使用)

python main.py --lowvram

# CPU モード(非常に遅いが、あらゆるハードウェアで動作します。最後の手段としてのみ使用してください)

python main.py --cpu

# プレビューを無効化(VRAM と処理を節約)

python main.py --preview-method none

# 最適化されたアテンションメカニズムを使用

python main.py --use-pytorch-cross-attention

python main.py --use-flash-attention

# 非同期ウェイトオフローディング

python main.py --async-offload

# OS 用に特定の VRAM 量を予約(GB 単位)

python main.py --reserve-vram 2

# スマートメモリ管理を無効化

python main.py --disable-smart-memory

# 異なるキャッシュ戦略を使用

python main.py --cache-none # RAM 使用量は少ないが、遅い

python main.py --cache-lru 10 # 10 個の結果をキャッシュ、高速

python main.py --cache-classic # 古いスタイル(攻撃的)のキャッシュを使用

インストール固有の問題

デスクトップアプリの問題

包括的なデスクトップインストールのトラブルシューティングについては、デスクトップインストールガイド を参照してください。

- サポートされていないデバイス: ComfyUI Desktop Windows は CUDA を搭載した NVIDIA GPU のみをサポートしています。他の GPU については ComfyUI Portable または 手動インストール を使用してください

- インストールに失敗: インストーラーを管理者として実行し、少なくとも 15GB のディスク容量を確保してください

- メンテナンスページ: ダウンロードに失敗する場合は ミラー設定 を確認してください

- モデルが見つからない: モデルは移行中にコピーされず、リンクのみされます。モデルパスを確認してください

- 「アプリが破損しています」: セキュリティとプライバシー設定でアプリを許可してください

- パフォーマンスの問題: プライバシー設定でフルディスクアクセスを付与してください

- クラッシュ: コンソールアプリでクラッシュレポートを確認してください

- ライブラリが見つからない: パッケージマネージャーで依存関係をインストールしてください

- LD_LIBRARY_PATH エラー: PyTorch ライブラリパスの問題(下記参照)

手動インストールの問題

Python バージョンの競合:

# Python バージョンを確認(3.9+ が必要、3.12 を推奨)

python --version

# 仮想環境を使用(推奨)

python -m venv comfyui_env

source comfyui_env/bin/activate # Linux/Mac

comfyui_env\Scripts\activate # Windows

# まず pip を更新

python -m pip install --upgrade pip

# 依存関係をインストール

pip install -r requirements.txt

# NVIDIA GPU 用(CUDA 13.0)

pip install torch torchvision torchaudio --extra-index-url https://download.pytorch.org/whl/cu130

# AMD GPU 用(Linux のみ - ROCm 7.2)

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/rocm7.2

Linux 固有の問題

LD_LIBRARY_PATH エラー:

一般的な症状:

- “libcuda.so.1: cannot open shared object file”

- “libnccl.so: cannot open shared object file”

- “ImportError: libnvinfer.so.X: cannot open shared object file”

解決策:

- 最新の PyTorch インストール(最も一般的):

# NVIDIA パッケージ付き仮想環境用

export LD_LIBRARY_PATH=$VIRTUAL_ENV/lib/python3.12/site-packages/nvidia/nvjitlink/lib:$LD_LIBRARY_PATH

# conda 環境用

export LD_LIBRARY_PATH=$CONDA_PREFIX/lib/python3.12/site-packages/nvidia/nvjitlink/lib:$LD_LIBRARY_PATH

# または Python site-packages を自動的に検索

PYTHON_PATH=$(python -c "import site; print(site.getsitepackages()[0])")

export LD_LIBRARY_PATH=$PYTHON_PATH/nvidia/nvjitlink/lib:$LD_LIBRARY_PATH

# 他の NVIDIA ライブラリも必要になる場合があります

export LD_LIBRARY_PATH=$PYTHON_PATH/nvidia/cuda_runtime/lib:$LD_LIBRARY_PATH

export LD_LIBRARY_PATH=$PYTHON_PATH/nvidia/cublas/lib:$LD_LIBRARY_PATH

- 持っているライブラリを検索:

# インストールされている NVIDIA パッケージを確認

python -c "import site; import os; nvidia_path=os.path.join(site.getsitepackages()[0], 'nvidia'); print('NVIDIA libs:', [d for d in os.listdir(nvidia_path) if os.path.isdir(os.path.join(nvidia_path, d))] if os.path.exists(nvidia_path) else 'Not found')"

# PyTorch が必要とする不足しているライブラリを検索

python -c "import torch; print(torch.__file__)"

ldd $(python -c "import torch; print(torch.__file__.replace('__init__.py', 'lib/libtorch_cuda.so'))")

- 環境に対して永続的に設定:

# 仮想環境の場合、アクティベーションスクリプトに追加

echo 'export LD_LIBRARY_PATH=$VIRTUAL_ENV/lib/python*/site-packages/nvidia/nvjitlink/lib:$LD_LIBRARY_PATH' >> $VIRTUAL_ENV/bin/activate

# conda 環境の場合

conda env config vars set LD_LIBRARY_PATH=$CONDA_PREFIX/lib/python*/site-packages/nvidia/nvjitlink/lib:$LD_LIBRARY_PATH

# グローバル bashrc 用(必要に応じて Python バージョンを調整)

echo 'export LD_LIBRARY_PATH=$(python -c "import site; print(site.getsitepackages()[0])")/nvidia/nvjitlink/lib:$LD_LIBRARY_PATH' >> ~/.bashrc

- 代替案:ldconfig を使用:

# 現在のライブラリキャッシュを確認

ldconfig -p | grep cuda

ldconfig -p | grep nccl

# 不足している場合、ライブラリパスを追加(root 権限が必要)

sudo echo "/usr/local/cuda/lib64" > /etc/ld.so.conf.d/cuda.conf

sudo ldconfig

- ライブラリローディングをデバッグ:

# 不足しているものを見るための詳細ライブラリローディング

LD_DEBUG=libs python main.py 2>&1 | grep "looking for"

# PyTorch CUDA の可用性を確認

python -c "import torch; print('CUDA available:', torch.cuda.is_available()); print('CUDA version:', torch.version.cuda)"

モデル関連の問題

アーキテクチャの不一致、モデルの欠落、読み込みエラーを含む包括的なモデルのトラブルシューティングについては、専用の モデル問題 ページを参照してください。

ネットワークと API の問題

API ノードが機能しない

症状: API 呼び出しが失敗する、タイムアウトエラー、クォータ超過

解決策:

- API キーの有効性を確認 - ユーザー設定 でキーを検証してください

- アカウントクレジットを確認 - 十分な API クレジット があることを確認してください

- インターネット接続を検証 - 他のオンラインサービスでテストしてください

- サービスステータスを確認 - プロバイダーがダウンタイムを経験している可能性があります

接続の問題

症状: 「Failed to connect to server」、タイムアウトエラー

解決策:

- ファイアウォール設定を確認 - ファイアウォールを通じて ComfyUI を許可してください

- 異なるポートを試す - デフォルトは 8188、8189 または 8190 を試してください

- VPN を一時的に無効化 - VPN が接続をブロックしている可能性があります

- プロキシ設定を確認 - 必要ない場合はプロキシを無効にしてください

フロントエンドの問題

「Frontend or Templates Package Not Updated」:

# Git 経由で ComfyUI を更新した後、フロントエンドの依存関係を更新

pip install -r requirements.txt

- ComfyUI 設定でノード検証を無効にしてください

「Error Toast About Workflow Failing Validation」:

- 設定でワークフロー検証を一時的に無効にしてください

- ComfyUI チームに問題を報告してください

localhost 以外でのログイン問題:

- 通常のログインは localhost からアクセスする場合のみ機能します

- LAN/リモートアクセス用:platform.comfy.org/login で API キーを生成

- ログインダイアログで API キーを使用するか、

--api-key コマンドライン引数を使用

ハードウェア固有の問題

NVIDIA GPU の問題

「Torch not compiled with CUDA enabled」エラー:

# まず torch をアンインストール

pip uninstall torch

# CUDA 13.0 で安定版 PyTorch をインストール

pip install torch torchvision torchaudio --extra-index-url https://download.pytorch.org/whl/cu130

# ナイトリービルド用(パフォーマンスの改善がある場合があります)

pip install --pre torch torchvision torchaudio --index-url https://download.pytorch.org/whl/nightly/cu132

# CUDA サポートを検証

python -c "import torch; print(torch.cuda.is_available())"

# GPU が見えているか確認

nvidia-smi

# ドライバーバージョンと CUDA 互換性を確認

nvidia-smi --query-gpu=driver_version --format=csv

AMD GPU の問題

ROCm サポート(Linux のみ):

# 安定版 ROCm PyTorch をインストール(執筆時点では 7.2)

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/rocm7.2

# ナイトリービルド用(執筆時点では ROCm 7.2)、パフォーマンスの改善がある場合があります

pip install --pre torch torchvision torchaudio --index-url https://download.pytorch.org/whl/nightly/rocm7.2

# RDNA2 またはそれ以前用(6700、6600)

HSA_OVERRIDE_GFX_VERSION=10.3.0 python main.py

# RDNA3 カード用(7600)

HSA_OVERRIDE_GFX_VERSION=11.0.0 python main.py

# 実験的なメモリ効率的アテンションを有効化(PyTorch 2.4 では不要)

TORCH_ROCM_AOTRITON_ENABLE_EXPERIMENTAL=1 python main.py --use-pytorch-cross-attention

# チューナブルオペレーションを有効化(初回実行は遅いが、その後の実行は高速)

PYTORCH_TUNABLEOP_ENABLED=1 python main.py

Apple Silicon (M1/M2/M3) の問題

MPS バックエンド設定:

# Apple Silicon 用 PyTorch ナイトリーをインストール

# Apple のガイドに従ってください:https://developer.apple.com/metal/pytorch/

# MPS の可用性を確認

python -c "import torch; print(torch.backends.mps.is_available())"

# ComfyUI を起動

python main.py

# CPU モードを強制

python main.py --cpu

# メモリ最適化付き

python main.py --force-fp16 --cpu

Intel GPU の問題

オプション 1: ネイティブ PyTorch XPU サポート(Windows/Linux):

# XPU サポート付き PyTorch ナイトリーをインストール

pip install --pre torch torchvision torchaudio --index-url https://download.pytorch.org/whl/nightly/xpu

# ComfyUI を起動

python main.py

# Intel Arc A-Series Graphics 用

conda install libuv

pip install torch==2.3.1.post0+cxx11.abi torchvision==0.18.1.post0+cxx11.abi torchaudio==2.3.1.post0+cxx11.abi intel-extension-for-pytorch==2.3.110.post0+xpu --extra-index-url https://pytorch-extension.intel.com/release-whl/stable/xpu/us/

ヘルプの入手とバグの報告

バグを報告する前に

-

既知の問題かどうかを確認:

-

基本的なトラブルシューティングを試す:

効果的にバグを報告する方法

ComfyUI コアの問題用

報告先: GitHub Issues

デスクトップアプリの問題用

報告先: デスクトップ GitHub Issues

フロントエンドの問題用

報告先: フロントエンド GitHub Issues

カスタムノードの問題用

報告先: 特定のカスタムノード開発者に連絡

必要な情報

問題を報告する際は、以下を含めてください:

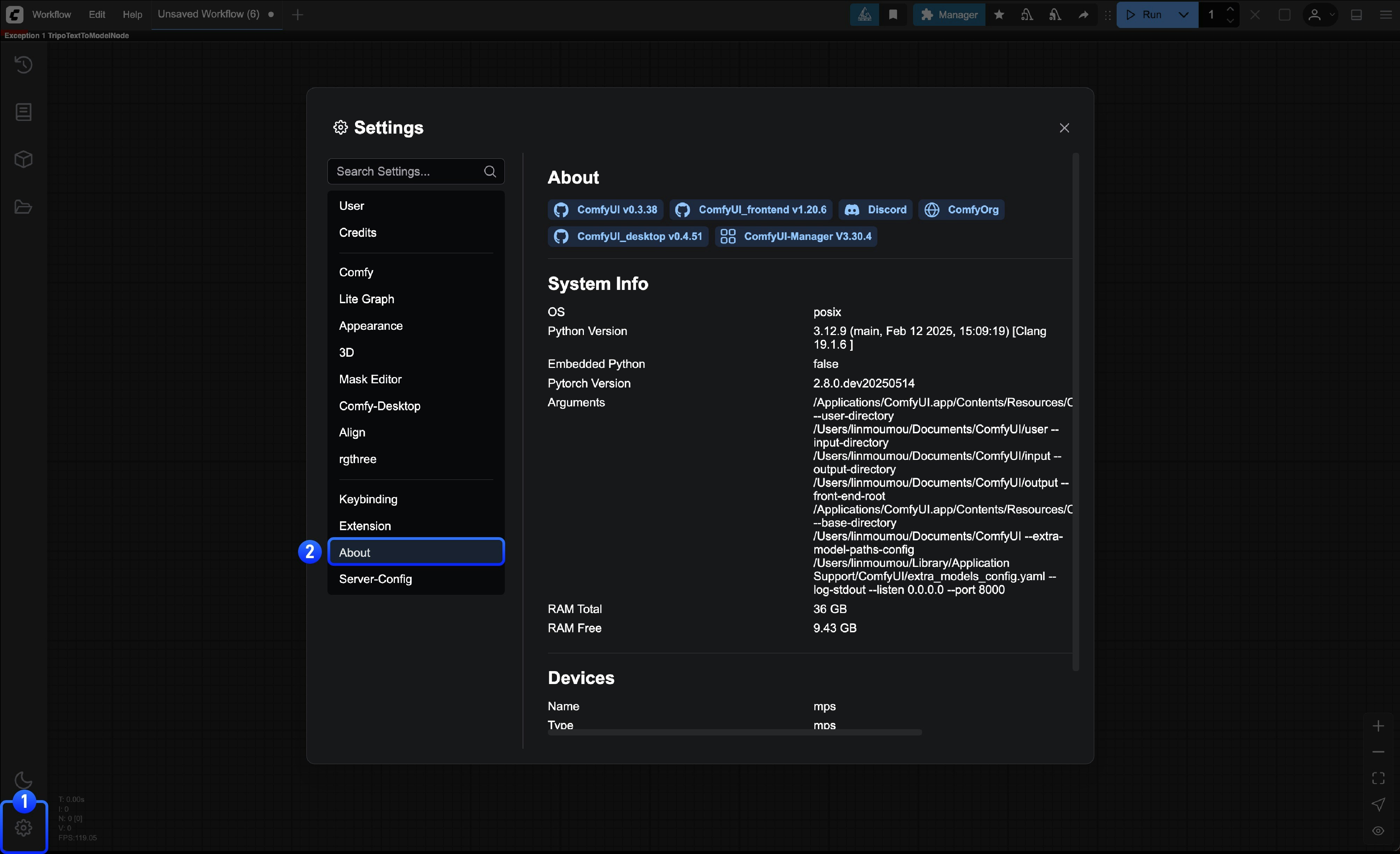

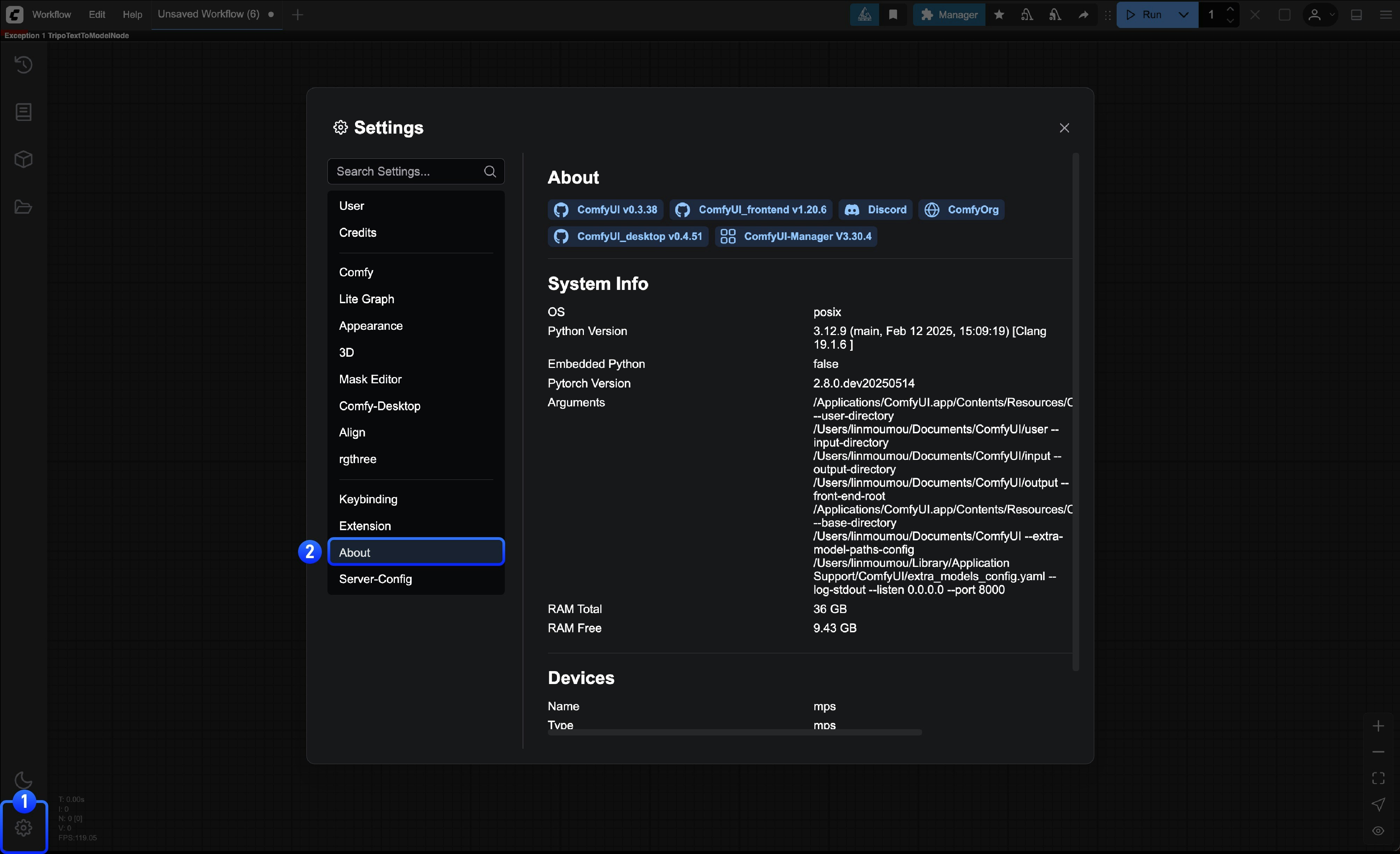

システム情報

ComfyUI インターフェースから

コマンドラインから

システム情報(設定の关于ページで見つかります):

-

オペレーティングシステム(Windows 11、macOS 14.1、Ubuntu 22.04 など)

-

ComfyUI バージョン(設定の关于ページを確認)

-

Python バージョン:

python --version

-

PyTorch バージョン:

python -c "import torch; print(torch.__version__)"

-

GPU モデルとドライバーバージョン

-

インストール方法(デスクトップ、ポータブル、手動、comfy-cli)

# システム情報

systeminfo | findstr /C:"OS Name" /C:"OS Version"

# GPU 情報

wmic path win32_VideoController get name

# Python と PyTorch 情報

python --version

python -c "import torch; print(f'PyTorch: {torch.__version__}')"

python -c "import torch; print(f'CUDA Available: {torch.cuda.is_available()}')"

# システム情報

uname -a

# GPU 情報(Linux)

lspci | grep VGA

# Python と PyTorch 情報

python --version

python -c "import torch; print(f'PyTorch: {torch.__version__}')"

python -c "import torch; print(f'CUDA Available: {torch.cuda.is_available()}')"

デスクトップアプリの問題

デスクトップアプリの問題の場合は、以下も含めてください:

- ログファイル:

C:\Users\<username>\AppData\Roaming\ComfyUI\logs(Windows)

- 設定ファイル:

C:\Users\<username>\AppData\Roaming\ComfyUI(Windows)

問題の詳細

問題の詳細:

- 問題の明確な説明

- 問題を再現する手順

- 期待される動作と実際の動作

- 該当する場合はスクリーンショットまたは動画

エラーメッセージ:

- コンソール/ターミナルからの完全なエラーテキスト

- ブラウザコンソールエラー(F12 → コンソールタブ)

- クラッシュログまたはエラーダイアログ

追加のコンテキスト

追加のコンテキスト:

- インストールされているカスタムノードのリスト

- 問題を再現するワークフローファイル(.json)

- 最近の変更(新しいインストール、更新など)

コミュニティリソース