通常は、満足のいく画像を得るまで、多数の生成試行を繰り返す必要があります。しかし、ControlNet の登場により、この課題は効果的に解決されました。 ControlNet は、拡散モデル(例:Stable Diffusion)に基づく条件付き制御生成モデルであり、2023 年に Lvmin Zhang 氏と Maneesh Agrawala 氏らが論文『Adding Conditional Control to Text-to-Image Diffusion Models』において初めて提案しました。 ControlNet モデルは、エッジ検出マップ、深度マップ、ポーズキーポイントなどのマルチモーダルな入力条件を導入することで、画像生成の制御性および細部の再現能力を大幅に向上させます。

これにより、画像のスタイル、ディテール、人物のポーズ、構図など、さまざまな要素をさらに精密に制御可能になります。これらの制約条件によって、画像生成はより確実なものとなり、描画プロセス中に複数の ControlNet モデルを同時に活用することも可能になり、より優れた結果を得られます。 ControlNet が登場する前は、モデルに画像を生成させ続け、偶然得られた結果から満足のいくものを選ぶしかなく、その過程には多くのランダム性が伴っていました。

たとえば、簡単なスケッチを用いて画像生成プロセスをガイドすれば、そのスケッチに極めて近い画像を生成することが可能です。

ControlNet 画像前処理に関する情報

異なる種類の ControlNet モデルは、通常、異なるタイプの参照画像を必要とします:

出典:ComfyUI ControlNet aux現在の Comfy Core ノードには、すべての種類の プリプロセッサ が含まれていないため、本ドキュメントの実際の例では、あらかじめ前処理済みの画像を提供します。

ただし、実際の利用時には、各 ControlNet モデルの要件を満たすために、カスタムノードを用いて画像の前処理を行う必要がある場合があります。以下に、関連するカスタムノードをいくつかご紹介します:

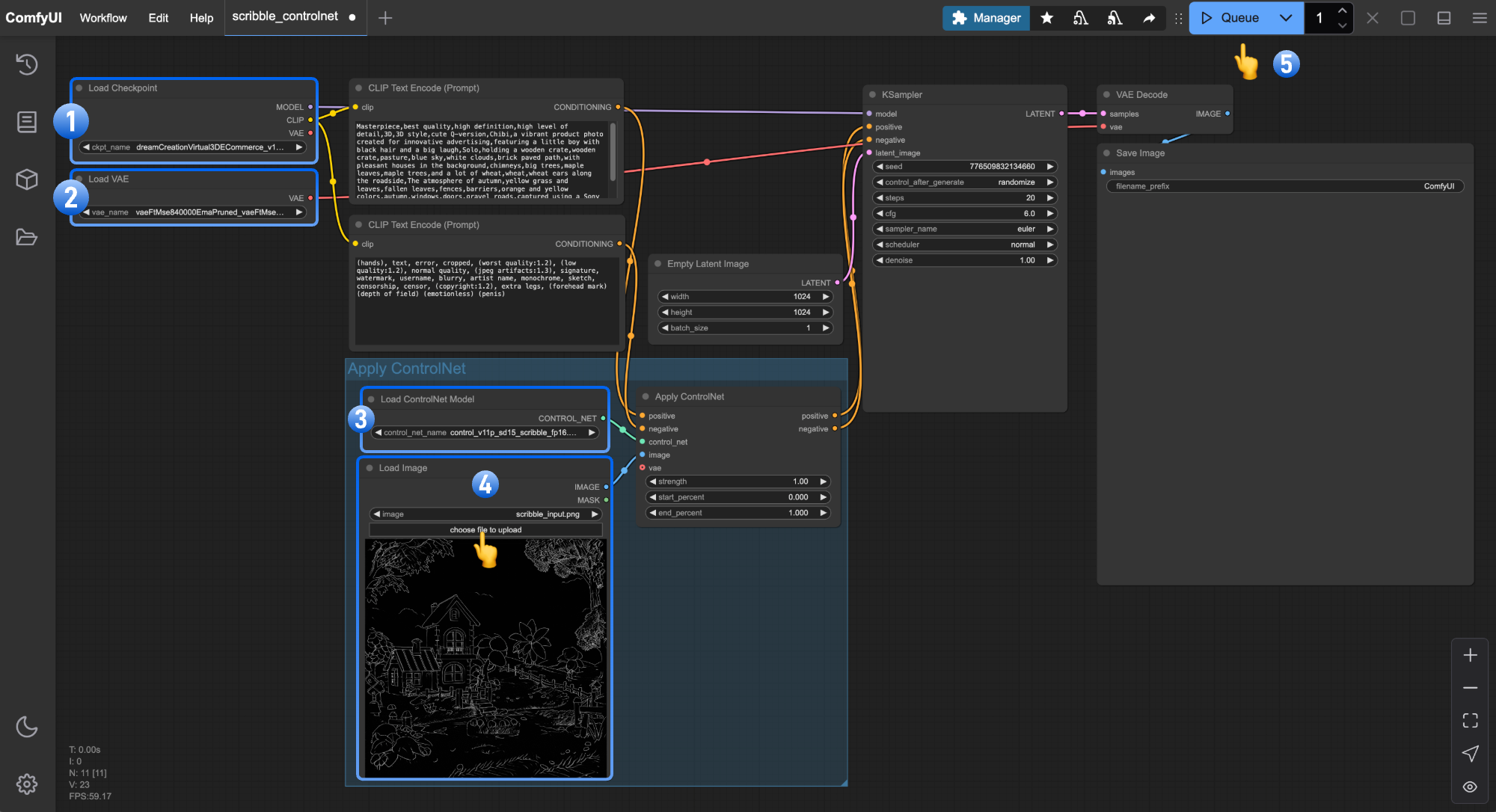

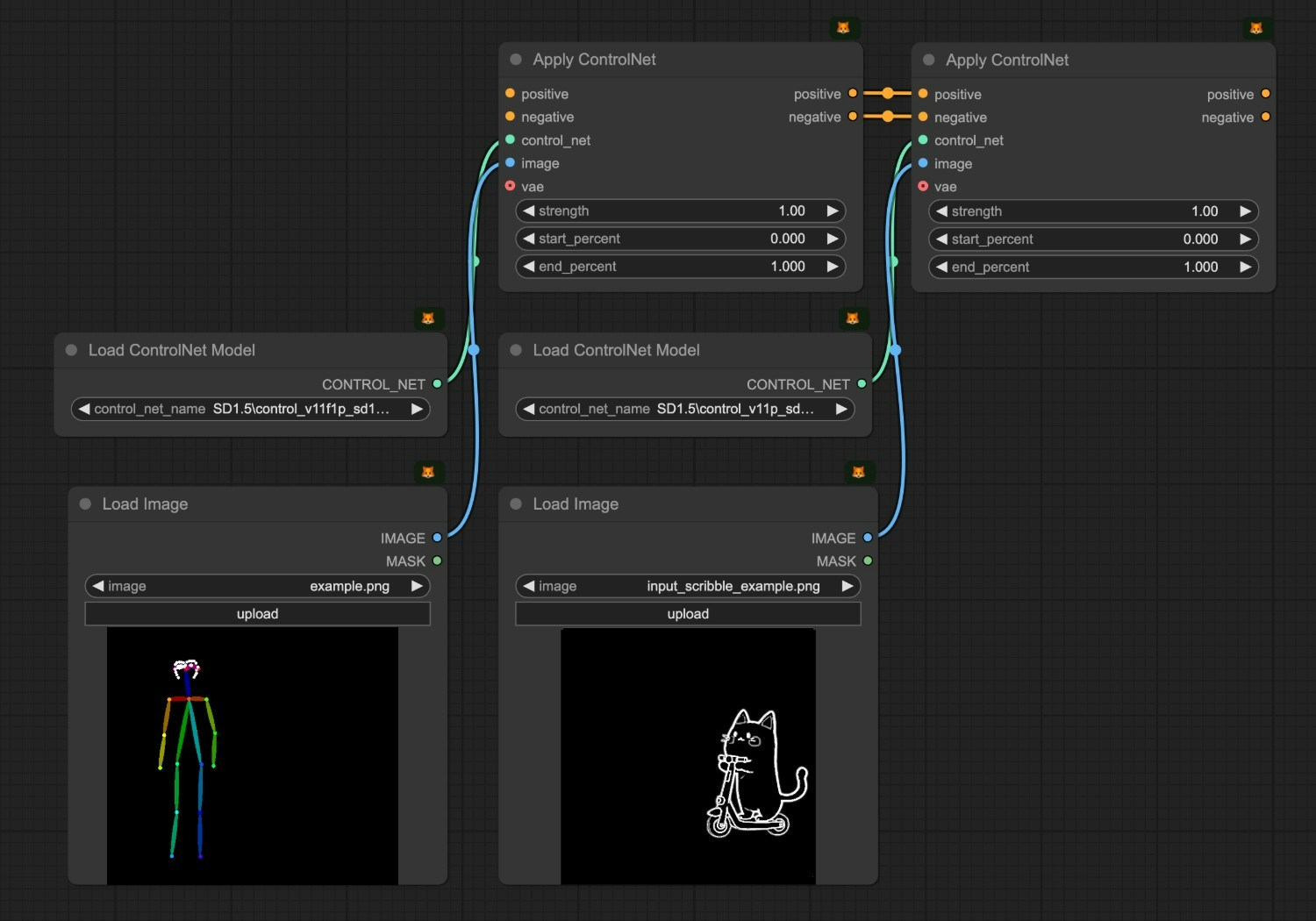

ComfyUI ControlNet ワークフローの例の解説

1. ControlNet ワークフローのアセット

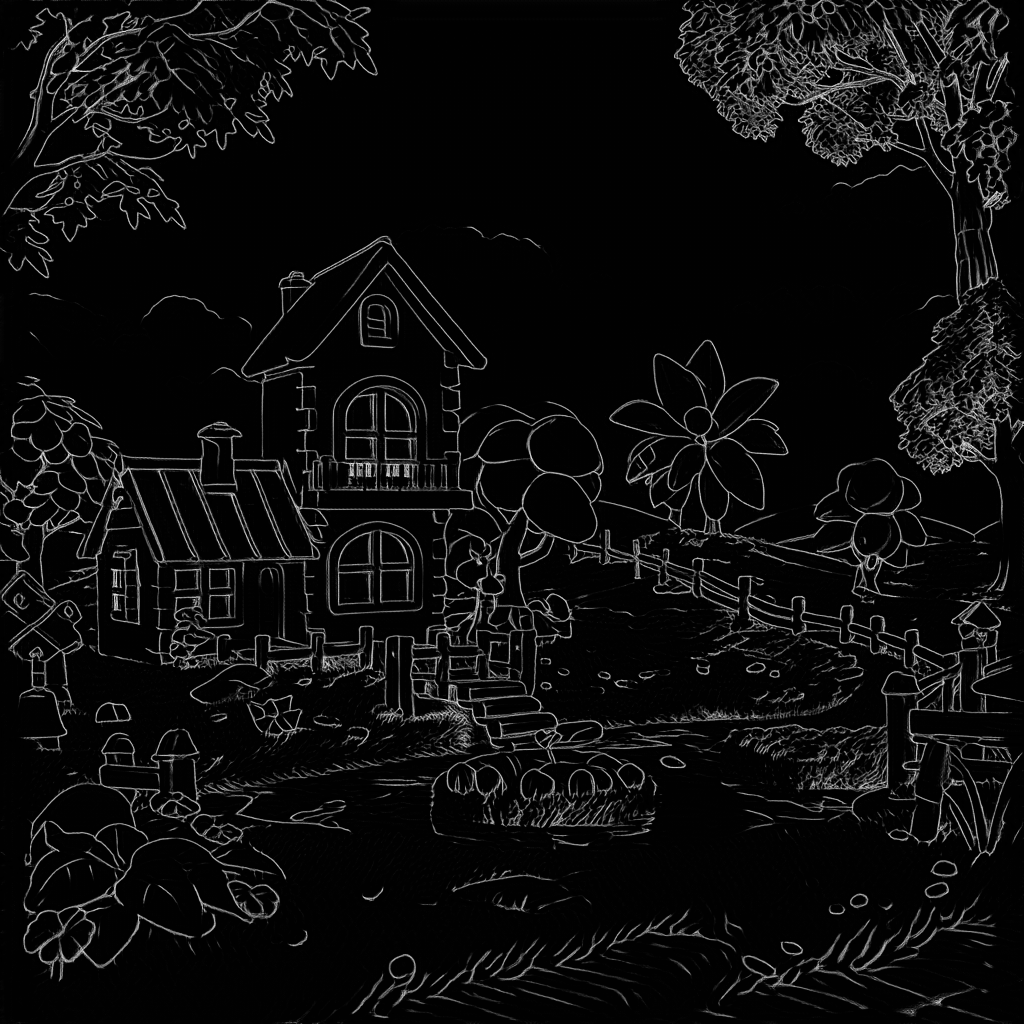

以下のワークフロー画像をダウンロードし、ComfyUI へドラッグ&ドロップしてワークフローを読み込んでください: 以下の画像をダウンロードしてください。本例では、これを入力画像として使用します:

以下の画像をダウンロードしてください。本例では、これを入力画像として使用します:

2. 手動によるモデルインストール

ネットワーク環境により、対応するモデルの自動ダウンロードが失敗する場合は、以下のモデルを手動でダウンロードし、指定されたディレクトリに配置してください:

- dreamCreationVirtual3DECommerce_v10.safetensors

- vae-ft-mse-840000-ema-pruned.safetensors

- control_v11p_sd15_scribble_fp16.safetensors

本例では、

dreamCreationVirtual3DECommerce_v10.safetensors に内蔵されている VAE モデルを使用することも可能ですが、モデル作者の推奨に従い、別途 VAE モデルを用いる形で進めています。3. ワークフローのステップバイステップ実行

Load Checkpointが dreamCreationVirtual3DECommerce_v10.safetensors を正常に読み込めることを確認してくださいLoad VAEが vae-ft-mse-840000-ema-pruned.safetensors を正常に読み込めることを確認してくださいLoad Imageノード内のUploadをクリックし、前述の入力画像をアップロードしてくださいLoad ControlNetが control_v11p_sd15_scribble_fp16.safetensors を正常に読み込めることを確認してくださいQueueボタンをクリックするか、ショートカットCtrl(cmd) + Enterを使用して画像生成を実行してください

関連ノードの解説

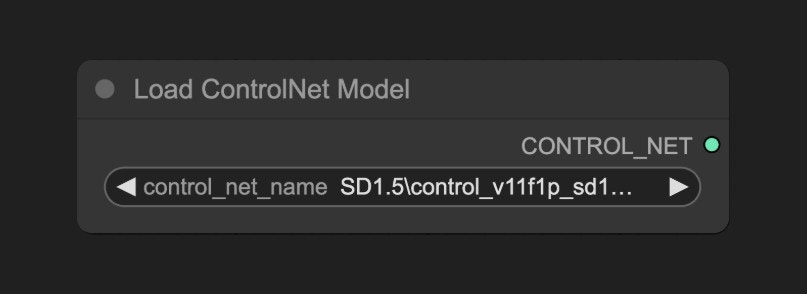

Load ControlNet ノードの解説

ComfyUI\models\controlnet ディレクトリ内に配置されたモデルは、ComfyUI によって自動検出され、このノードから読み込むことができます。

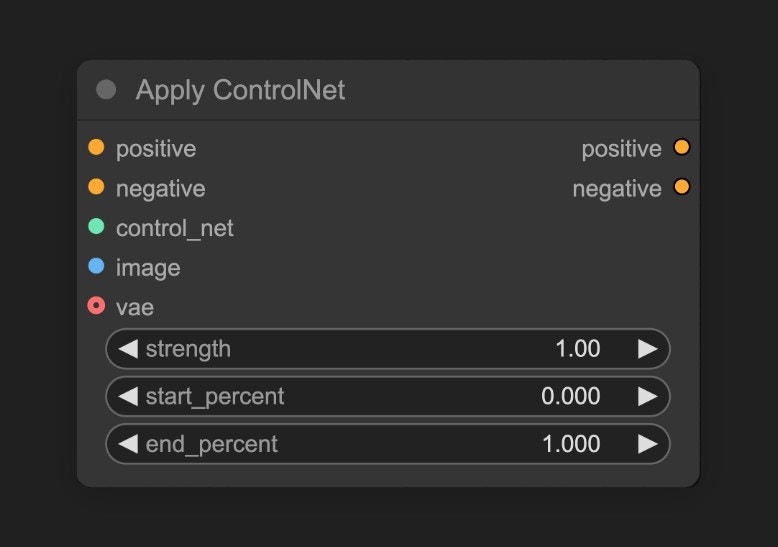

Apply ControlNet ノードの解説

load controlnet で読み込んだ ControlNet モデルを受け取り、入力画像に基づいて対応する制御条件を生成します。

入力パラメータ

| パラメータ名 | 機能 |

|---|---|

positive | 正の条件(ポジティブ・コンディショニング) |

negative | 負の条件(ネガティブ・コンディショニング) |

control_net | 適用する ControlNet モデル |

image | ControlNet の適用に用いる参照画像(事前に前処理済みの画像) |

vae | VAE モデルの入力 |

strength | ControlNet の適用強度。値が大きいほど、生成画像に対する ControlNet の影響が強くなります |

start_percent | ControlNet の適用開始タイミング(拡散プロセスの進行率で指定)。例:0.2 は、拡散プロセスが全体の 20% 完了した時点で制御を開始することを意味します |

end_percent | ControlNet の適用終了タイミング(拡散プロセスの進行率で指定)。例:0.8 は、拡散プロセスが全体の 80% 完了した時点で制御を終了することを意味します |

| パラメータ名 | 機能 |

|---|---|

positive | ControlNet により処理された正の条件データ |

negative | ControlNet により処理された負の条件データ |

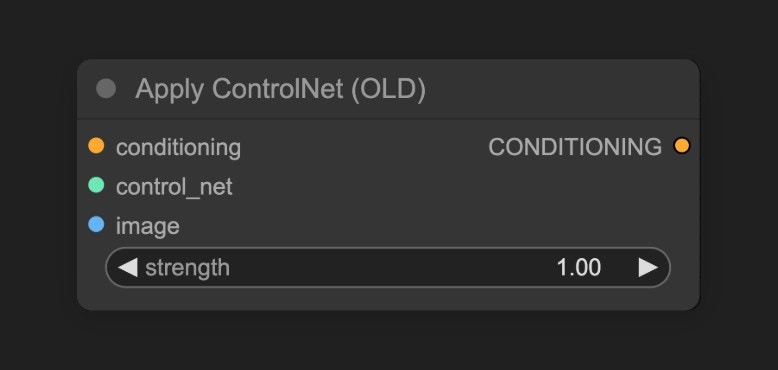

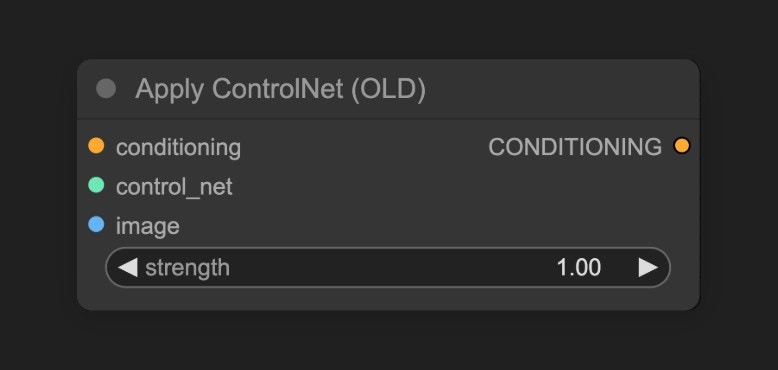

一部の古いワークフローでは、

有効化するには、Settings → comfy → Node から

Apply ControlNet(Old) というノードが見られることがあります。これは初期バージョンの ControlNet ノードであり、現在は非推奨となっており、検索やノードリストにはデフォルトで表示されません。

有効化するには、Settings → comfy → Node から

Show deprecated nodes in search オプションを有効にしてください。ただし、新規ノードの使用を推奨します。さっそく体験してみましょう

- 似たようなスケッチを作成したり、自分で手描きしてみたりし、ControlNet モデルを用いて画像を生成して、その利便性をぜひ体感してください。

Apply ControlNetノードのControl Strengthパラメータを調整し、ControlNet モデルの生成画像への影響度をコントロールしてみてください。- ControlNet-v1-1_fp16_safetensors リポジトリを訪れ、他の種類の ControlNet モデルをダウンロードし、それらを用いた画像生成にチャレンジしてみてください。